1.1 背景

1.1.1 问题引入

开发一个应用,接收地理信息、卫星图像和历史天气数据,并预测次日的天气;创建一个程序,接受自然语言形式的问题并准确作答;构建一款软件,接收一张图片,识别其中的人物,并在每个人物周围画出边界线;设计一个系统,推荐用户可能感兴趣但不易偶然发现的产品。

机器学习(machine learning, ML)是一系列能从经验中自我提升的技术。通常通过观察数据或与环境的互动形式,机器学习算法能够累积更多经验,从而逐渐提高性能。

1.2 日常生活中的机器学习

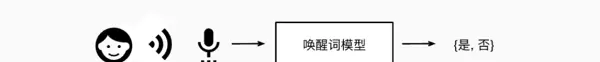

1.2.1 识别唤醒词

参数(parameter)

我们仅需设计一个灵活的程序算法,其输出结果由多个参数决定,然后利用数据集来确定当前的“最优参数组合”,这些参数通过某种性能评估方式实现任务的最佳效果。

模型(model)

任何经过调整参数后的

程序

均称为模型(model)。

学习(learning)

在机器学习领域,

学习(learning)是指训练模型的过程。

通过这一过程,我们能够找到正确的参数集,使模型执行所需行为。

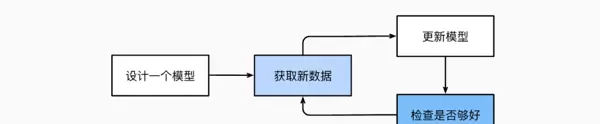

1.2.2 模型训练

从一个随机初始化的模型开始,该模型几乎没有“智能”;

获取一些数据样本(例如,音频片段及其对应的肯定或否定标签);

调整参数,使模型在这些样本上表现更佳;

重复第2步和第3步,直至模型的任务表现令人满意。

1.3 机器学习中的关键组件

可用于学习的数据(data);

如何转换数据的模型(model);

一个目标函数(objective function),用于衡量模型的有效性;

调整模型参数以优化目标函数的算法(algorithm)。

1.3.1 数据

每个数据集由一个个示例(example, sample)构成。

大部分情况下,它们遵循独立同分布(independently and identically distributed, i.i.d.)。

示例有时也称为数据点(data point)或数据实例(data instance),通常每个示例由一组称为特征(features,或协变量covariates)的属性组成。

机器学习模型将依据这些属性进行预测。在上述监督学习问题中,需预测的一个特殊属性被称为标签(label,或目标target)。

当每个示例的特征类别数量相同时,其特征向量为固定长度,这个长度即数据的维度(dimensionality)。

1.3.2 模型

深度学习

深度学习与传统方法的主要区别在于:前者侧重于功能强大的模型,这些模型由神经网络紧密交织而成,包含多层数据转换,因此称为深度学习(deep learning)。

1.3.3 目标函数

目标函数

在机器学习中,我们需要定义衡量模型优劣的度量,这个度量在多数情况下是“可优化”的,这被称作

目标函数(objective function)

。

损失函数

我们通常设定一个目标函数,并力求将其最小化。因为越低越好,所以这些函数有时被称为

损失函数(loss function,或成本函数cost function)。在尝试预测数值的任务中,最常用的损失函数是平方误差(squared error),即预测值与实际值之差的平方。

损失函数基于模型参数定义,并依赖于数据集。该数据集由为训练收集的一系列样本构成,称为训练数据集(training dataset,或简称训练集training set)。

在训练数据上表现优秀的模型,在“新数据集”上的性能未必相同,“新数据集”通常称为测试数据集(test dataset,或简称测试集test set)。

训练数据用于拟合模型参数,而测试数据用于评估已拟合的模型。

过拟合

当一个模型在训练集上表现良好,但在测试集上的推广能力差时,这种情况称为过拟合(overfitting)。

1.3.4 优化算法

梯度下降

在获得了一些数据源及其表示、一个模型和合适的损失函数后,接下来需要一种能够寻找最佳参数以最小化损失函数的算法。在深度学习中,大多数流行的优化算法通常基于基本方法——梯度下降(gradient descent)。

1.4 机器学习问题

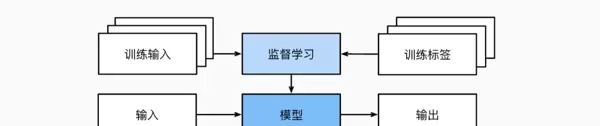

1.4.1 监督学习

监督学习(supervised learning)擅长在“给定输入特征”的情况下预测标签。每个“特征-标签”对称为一个示例(example)。

监督学习的学习过程:

从已知大量数据样本中随机选取子集,为每个示例获取真实标签。有时,这些样本已有标签(例如,患者是否在下一年内康复?);有时,则需人工标注(例如,图像分类)。这些输入及其相应的标签共同构成训练数据集。

选取监督式学习算法,它接收训练数据集作为输入,并生成一个“已训练的模型”;将未曾见过的数据特征应用到此“已训练的模型”中,利用模型的输出来预测相应的标签。

监督学习的模型

回归(regression)识别回归问题的一个实用经验法则是,任何涉及“数量”的问题很可能属于回归问题。

分类:在分类问题中,目标是让模型预测样本归属于哪个类别(category, 专业术语称作类(class))。

多标签分类:当学习任务要求预测的类别之间不互相排斥时,则称为多标签分类(multi-label classification)。

搜索:在信息检索领域,目标是对一系列项目进行排序。

推荐系统:推荐系统(recommender system)旨在为特定用户提供“个性化”的建议。

序列学习:序列学习任务需要处理输入的序列或预测输出的序列,或者两者都需要。包括标记和解析、自动语音识别、文本到语音、机器翻译等。

1.4.2 无监督学习

这类不包含“目标”信息的数据集上进行的学习通常被称为无监督学习(unsupervised learning)。

聚类问题:在没有标签的情况下,我们能否对数据进行分类?

主成分分析问题:是否能找出少数参数精确地捕获数据的线性相关特征?

因果关系与概率图模型问题:能否描述出观察到的数据背后的根本原因?

生成对抗网络(generative adversarial networks):为合成数据,包括图像和音频等复杂非结构化数据提供了方法。

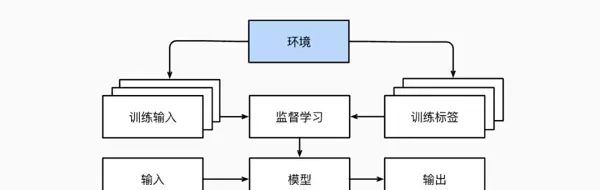

1.4.3 与环境的互动

离线学习无论是在监督式还是无监督式学习中,我们都会先获取大量数据,然后训练模型,在此过程中不再与外界交互。这种所有学习活动都在脱离实际环境后进行的方式被称为离线学习(offline learning)。

1.4.4 强化学习

在强化学习问题中,代理(agent)需在一系列时间点上与环境互动。每个特定的时间节点,代理从环境中接收观察结果,并必须选择一个动作执行,之后通过某种机制(有时称为执行器)将其反馈给环境,最终代理会获得奖励(reward)。

1.5 深度学习的进步

新的容量控制策略,如dropout (Srivastava et al., 2014),有助于减少过拟合的风险。注意力机制解决了困扰统计学一个多世纪的问题:如何在不增加可学习参数的情况下增强系统的记忆和复杂性。

多阶段设计,例如存储器网络(Sukhbaatar et al., 2015) 和神经编程解释器(Reed and De Freitas, 2015),它们允许统计建模者描绘出用于推理的迭代方法。生成对抗网络 (Goodfellow et al., 2014) 的创新之处在于用具有可微参数的任意算法替换了采样过程,通过调整这些数据使鉴别器(实际上是一种双样本测试)无法区分虚假和真实数据。这种利用任意算法生成数据的能力开启了各种技术在密度估计领域的应用。

构建并行及分布式训练算法的能力得到了显著提升,并行计算能力同样对强化学习的进展起到了关键作用。深度学习框架对于传播知识至关重要,第一代易于建模的框架包括Caffe、Torch和Theano等。

零基础入门AI大模型必看

我整理了多种资源,希望能帮助大家少走弯路!无论是学术还是职业发展,都祝愿你一帆风顺!

- 大模型入门学习路径图(含学习资料)

- 大模型方向必读电子书PDF版

- 大模型面试题库

- 大模型项目源代码

- 超详细海量大模型LLM实战案例

- Langchain/RAG/Agent学习资料

- LLM大模型系统从零开始入门教程

- 吴恩达最新大模型视频+课件

以上所有大模型资料包的内容都整理在我的公众号里,【小灰熊大模型】回复【6】自动发送,均为免费分享,可自行获取~

扫码加好友,拉您进群

扫码加好友,拉您进群